云开体育"边幅板"子任务则是终极挑战-开云·Kaiyun体育(中国)官方网站 登录入口

发布日期:2026-05-12 07:42 点击次数:118

云开体育

云开体育

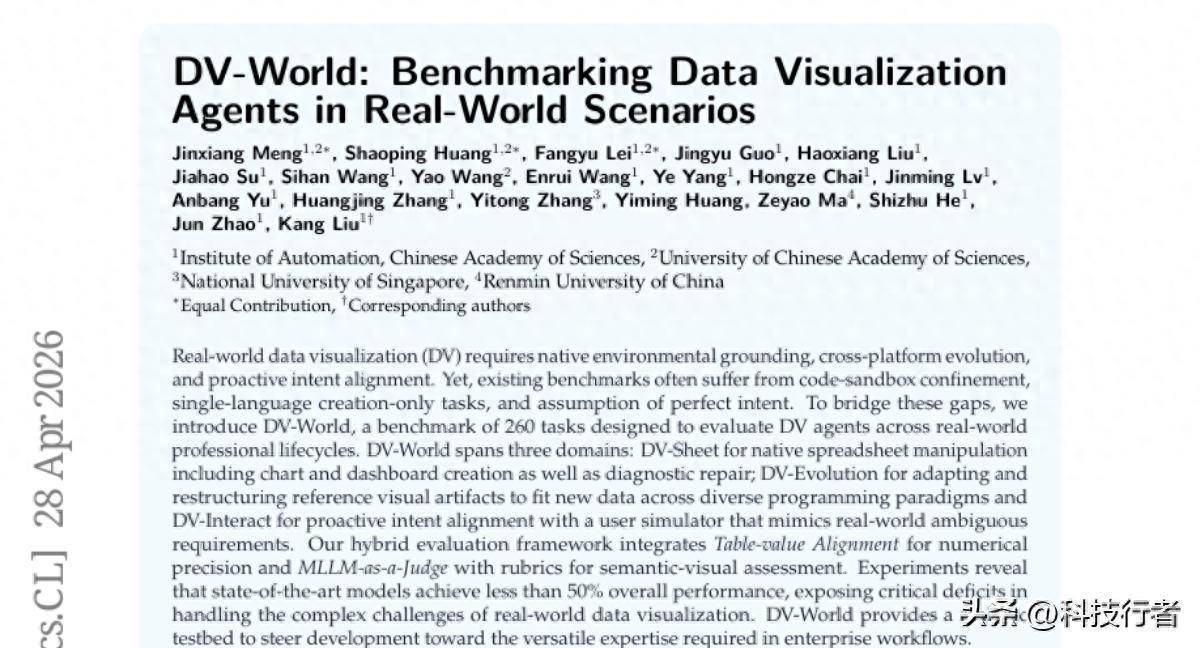

这项由中国科学院自动化考虑所、中国科学院大学、新加坡国立大学和中国东说念主民大学结伙开展的考虑,以预印本样子发布于2026年4月,论文编号为arXiv:2604.25914。有意思深入了解的读者不错通过该编号在arXiv平台查阅完整论文。

每当你灵通一份堆满数字的Excel表格,苦苦想索怎么把这些冷飕飕的数据变成一张让雇主目下一亮的图表时,你简略不会领悟到,这个看似闲居的日常挑战,恰是目前最顶尖的东说念主工智能系统集体翻车的处所。这支来自中国多所顶尖考虑机构的团队,恰是收拢了这个被学术界长期疏远的痛点,打造了一个名为"DV-World"的测试平台,专门用来考研AI在果真数据可视化责任中的实践发扬。论断出乎猜想:即即是目前人人最强劲的AI模子,在这套考题眼前也只可拼凑合格,得分广宽低于50%。

要领悟为什么这件事值得关心,不妨把数据可视化联想成一场厨艺比赛。往日的AI测试就像是让选手在方法化厨房里按照印好的食谱,用规格融合的食材作念出沿途菜,然后拍照打分——这固然比什么都不作念强,但它系数无法反应一个厨师在果真餐厅里责任时靠近的复杂气象:食材换了、宾客改了需求、上一个厨师作念了一半的菜需要你接办完成,而且你还得就地与主顾疏通阐明他到底想要什么口味。DV-World的意旨,恰是把这场考试从方法化厨房搬到了果真的餐厅后厨。

**一、现存测试平台的三大硬伤**

在持重先容DV-World之前,有必要先搞明晰现存的同类测试平台究竟缺了什么,毕竟在这项考虑发布之前,学术界依然有了不少测试AI数据可视化智力的决策,从ChartMimic到VisEval再到MatPlotBench,数目不少,为何还需要一个新的?

谜底藏在三个根人性的脱节里。第一个脱节,是"环境脱节"。现存的测试险些都把AI关在一个整洁的代码沙盒里——给你一份数据、一个任务阐扬,你用Python写几行代码,生成一张图片,完事。然而,果真宇宙里绝大多数普通职场东说念主员处理数据的样子,不是灵通Python末端,而是灵通Excel。Excel里的图表不是简便的图片,它是一个活生生的对象,与单元格里的数据及时集会,有我方的轴、系列、数据范围绑定干系。当你更正某个单元格的数值,图表会自动随之更新——这种"活"的数据绑定智力,恰是Excel图表区别于普通Python生成图片的中枢,亦然现存AI测试险些系数疏远的领域。

第二个脱节,是"创作至上"的近视眼。现存测试基本上都是一锤子买卖:给AI一个需求,AI从零运转生成一张图,打分,甩掉。但现实中的可视化责任那里是这么的?更多的时刻,你靠近的是一张已有的图表,需要换上新数据、按照新要求治疗样式、保留原有的遐想作风——就像画家不是每次都在空缺画布上作画,更多时刻是在别东说念主已有的画作基础上进行修改和再创作。这种"演化式"的可视化责任,在现存测试中险些是空缺。

第三个脱节,是对"无缺需求"的假定。险些系数现存测试都假定用户的需求是泄漏完整的,AI只需要依法践诺就好。而现实中的用户呢?"帮我作念个图分析一下咱们公司的事迹趋势"——这句话里有些许未被说出口的假定?是按月如故按季度?是用折线图如故柱状图?"事迹"指的是收入、利润如故销量?简略的可视化助手应该主动发现这些蒙胧之处并向用户求证,而不是造谣计算然后一册正经地输出一张可能系数无理的图表。

恰是为了填补这三个空缺,DV-World应时而生。

**二、DV-World的三张考卷**

DV-World包含260说念佛心遐想的题目,分为三大模块。这三个模块分裂查考了不同维度的智力,赶巧对应了上述三个脱节问题。

第一张考卷叫作念DV-Sheet,专门查考AI在原生Excel环境中的操作智力。这个模块包含130说念题,进一步细分为三种子类型。"创建"子任务要求AI把柄用户需求,在Excel责任簿里生成一张原生图表,况且图表必须通过单元格援用与数据动态绑定,不行是硬编码的静态数值——就像餐厅厨师不行把菜单上的价钱写死在菜里,而是要让价钱能跟着食材资本的变化而自动治疗。"建造"子任务则更像是接办前任厨师留住的烂摊子:拿到一个有问题的图表,会诊出无理所在并建造它。测试数据自满,74.5%的建造任务中存在噪声数据,无理类型多达12种,包括数据绑定无理、坐标轴缩放问题、图表类型与数据性质不匹配等。"边幅板"子任务则是终极挑战,要求AI把多张图表和数据表格组合成一个完整的买卖分析边幅板,像一个专科的BI报表遐想师一样谋划好全体布局、保证每个元素都传达出有价值的洞悉。

这个模块使用的数据平均每个责任簿有36列、进步11000行,这种领域的果真数据,对AI来说既是智力挑战,亦然现实感的来源。评分方面,DV-Sheet团结了两种机制:一种是"表格狡饰率",平直查抄AI生成的数据值是否与方法谜底匹配(对数字类数据允许渺小的差错容忍),另一种是基于AI大模子的视觉质料评判,两者团结给出最终分数。

第二张考卷叫作念DV-Evolution,包含80说念题,专门测试AI的"图扮演化"智力。每说念题给AI提供一张参考图片(展示方针样式)、一份新数据集,以及一些修改要求,AI需要领悟参考图片的视觉语义,把它"翻译"成能处理新数据的可践诺代码。更进修功底的是,这些代码还得在五种不同的可视化框架里分裂已矣:Python的Matplotlib/Seaborn、买卖数据大屏常用的Apache ECharts、学术可视化语法框架Vega-Lite、底层网页图形库D3.js,以及交互式分析常用的Plotly.js。就像一个厨师不仅要知说念怎么作念菜,还要能用中餐灶、法餐灶、日式铁板、好意思式烤架和印度泥炉分裂把同沿途菜作念出来。每个框架有我方的想维模式和语法章程,AI能否在它们之间自如切换,恰是这个模块要考研的中枢。

第三张考卷叫作念DV-Interact,包含50说念题,是三张考卷中最逼近果真用户场景的一张。每说念题都成就了一个有益蒙胧不清的可视化需求,AI需要通过与"用户模拟器"的多轮对话,冉冉厘清实在的需求,再生成最终图表。这个用户模拟器不是简便的问答机器东说念主,它有一套严格遐想的两阶段机制:第一阶段是"守门东说念主",专门检测AI是不是在试图走捷径——如果AI平直问"你想要什么代码"或者"告诉我数据库的列名是什么",守门东说念主会平直隔绝,因为这不是用户应该回答的问题;第二阶段是"回话生成器",把柄预设的荫藏果真需乞降反应章程,给出相宜普通用户领略水平的当然谈话回复,不包含任何时间细节,只说东说念主话。这确保了AI必须通过实在的领悟和推理来复原用户意图,而不是通过套取信息走捷径。每说念题平均成就了3.17个蒙胧点,狡饰15种不同类型的歧义,从"最近几年"到底是些许年、"高绩效"到底怎么界说,到"用收入如故利润"这类团聚逻辑歧义。

**三、考卷是怎么打分的**

这套评分体系自身就是一项紧迫的学术孝顺,因为它处置了一个长期困扰考虑者的用功:怎么公说念、准确地给可视化作品打分?

考虑团队继承了"搀和评估框架"。中枢量化目的叫作念"表格狡饰率",用于考研AI生成的数据值与方法谜底之间的吻合进程。这个目的使用了"称呼优先、类型其次"的智能对王人策略:先尝试通过列名匹配(去掉单元、融合大小写后比较),找不到匹配的列名时再把柄数据类型(数字型、日历型、类别型)进行推断性匹配。匹配得胜后,文本类数据要求精确至极,浮点数类数据允许在一定差错范围内视为匹配。

在此基础上,还有基于大模子的视觉质料评判。考虑团队邀请巨匠为每类任务遐想了多维度的评分信服,涵盖可靠性、适切性、好意思不雅性、完整性、一致性等维度,然后用AI大模子(主若是Gemini-2.5-Flash)按照这些信服为AI生成的图表打分。为了考证这套评分体系的可靠性,团队专门作念了东说念主工考证:在210说念题、3000多个评分容貌上,让东说念主类巨匠与AI评判系统分裂打分,效果自满两者的一致性极高(加权Kappa值达到0.821,组内关考虑数达到0.850),不同AI评判模子之间的模子名次统融合致。这意味着这套评分系统不是某个特定AI的偏见,而是反应了东说念主类巨匠水平的客不雅判断。

关于DV-Interact模块,还畸形引入了"交互得胜率"这个目的,空洞考量AI主动发问的次数、得胜处置歧义的轮次、以及被隔绝的失当发问次数,饱读吹AI高效、精确地发问,而非漫无目的地乱问或者压根不问。

**四、顶尖AI们考了些许分**

当这套考题摆在Gemini-3-Pro、GPT-5.2、DeepSeek-V3.2、Grok-4等一线AI模子眼前时,效果些许令东说念主无意。

在DV-Sheet模块,发扬最佳的是Gemini-3-Pro,总分仅为40.48分(满分100)。GPT-5.2和DeepSeek-V3.2都未能禁锢38分。比拟之下,东说念主类巨匠的得分高达80至88分,差距悬殊。具体来看,AI在三个子任务上的发扬芜乱不王人。在"创建"子任务中,数据准确性是最大的短板,进步50%的无理来源于数值计较无理和数据绑定问题。在"建造"子任务中,得胜率最高的AI(GLM-4.7、Grok-4)也只须40%多,而且不同类型的建造任务难度各别很大:过滤逻辑无理相对容易建造,但坐标轴缩放问题和视觉编码无理则让AI们广宽卡壳。在"边幅板"子任务中,一个道理的限定是:跟着数据表格领域的增大,AI的发扬会抓续下跌,当单元格总和进步50万时,险些系数模子的得分都接近腰斩——这阐扬大型数据集对AI的空间谋划和推明智力组成了实质性挑战。

考虑团队还发现了一个有益思的关联性:在"创建"子任务中,AI的表格狡饰率(数值准确性)和视觉好意思不雅性之间存在正关联干系。也就是说,数值算得越准,图表频频也画得越漂亮。这背后的逻辑很直观:如果连数据都搞错了,图表当然无从谈起。

在DV-Evolution模块,最高分由Gemini-3-Pro拿下,总分51.44分,其次是Gemini-3-Flash的49.46分和GPT-4.1的44.67分。各框架之间的发扬各别显耀:系数模子在Python和Vega-Lite上发扬相对较好,在D3.js和Plotly.js上发扬昭着较差。考虑团队分析合计,D3.js需要大宗低眉目的代码操作,生成代码行数频频进步500行,而考虑自满代码行数越多,AI的发扬就越差——这就好比让厨师写越来越详备的操作方法,反而越容易写错。另一个道剃头现是,当考虑东说念主员从AI的器具箱里拿走"加载图片"器具(即不让AI在生成代码过程中参考参考图)时,系数模子的发扬都有所下跌,其中Gemini-3-Pro在D3.js任务上的下跌幅度最大,达到7.69%——这阐扬视觉参考关于保抓语义针织度至关紧迫。

无理类型分析揭示了框架专属的失败模式:D3.js这类低眉目库主要让AI在样式上翻车(Gemini-3-Flash的视觉样式无理率高达40.96%),而Apache ECharts和Vega-Lite这类高眉目框架则主要显现AI在数据映射逻辑上的薄弱——前者数据一致性无理率最高达55%,后者布局无理率最高达51%。

在DV-Interact模块,Grok-4以40.43分领跑,但大多数顶尖模子都未能禁锢38分。更有益思的是,考虑团队发现"问题质料"远比"问题数目"紧迫。Grok-4和DeepSeek-V3.2的发问频率很高,但无效发问比例也高,最终收成反而不如发问更有针对性的Gemini-3-Pro。Gemini-3-Pro在"有无主动发问"两种情况下的性能差距高达23个百分点,是系数模子中发问质料与任务收益关联性最强的。与此同期,智力较弱的小模子在主动发问后性能反而下跌,阐扬低质料的发问非但帮不上忙,还会引入噪声。

从无理类型来看,DV-Interact的失败主要聚集在两种模式:一种是"领略践诺落差",即AI与用户得胜阐明了需求,却在最终身成图表时偏离了约定的内容,GPT-5.2在这一问题上的发生率高达60%;另一种是"交互藏匿",即AI过度自信地不经阐明平直践诺,GLM-4.7的这一问题发生率接近60%。

**五、这套题是怎么遐想出来的**

260说念题的背后,是18名可视化领域巨匠历时数月的经心遐想。

数据来源方面,团队从ExcelForum、MrExcel、Chandoo.org等果真的Excel用户社区汇聚了800多个果真问题帖子,以及Kaggle平台上的开放数据集。这些数据经过了三步处理:开始保留原始数据的结构特征(如吞并单元格、不章程布局),然后对数值进行扰动(在保抓数据漫衍限定的前提下替换具体数字),终末对个东说念主身份信息进行匿名化处理。这三步确保了数据既有果真感,又不骚扰秘籍。

题目遐想方面,不同类型的任务有不同的遐想权术。关于"创建"和"边幅板"类任务,继承了两阶段历程:先由五名巨匠融合法式题目措辞,再由另外七名巨匠寂寥完成任务,以减少单一巨匠偏见。关于"建造"任务,巨匠先制作出正确的图表,再系统性地注入种种常见无理,确保每说念题都有确定性的正确谜底。关于DV-Evolution任务,巨匠考证了参考已矣与方针已矣之间的语义等价性,并确保方针代码严格慑服"不硬编码"原则。关于DV-Interact任务,巨匠从一个具体明确的可视化需求开赴,系统性地引入受控的歧义点,纪录下处置这些歧义的问答模式,造成荫藏的"果真意图"文档和"反应章程"查找表。

评分信服的遐想不异费时致力于,每份评分信服平均需要巨匠破耗约6小时进行遐想,并经过多轮评审达成共鸣。为了缩小漏判率,巨匠还专门汇聚了五个不同AI模子的输出样本,确保评分信服能够狡饰多样合理的解题策略。

**六、用户模拟器有多果真**

DV-World的用户模拟器是整套系统中最有创意的遐想之一,因此值得单独张开讲讲。

模拟器使用GPT-5-Mini(即OpenAI的轻量级高效模子)动作底层大脑,这个选拔并非无意——考虑团队对比了包括Gemini-3-Pro、O4-mini、GPT-4.1等在内的9种不同模子动作模拟器时的发扬,发现GPT-5-Mini在"领导针织度"(与预设果真意图的匹配进程)和"与东说念主类行为的关联性"两个维度上都达到了最优均衡,且资本最低,号称性价比之王。GPT-5-Mini达到了88.67%的针织度和0.86的皮尔逊关考虑数(这个数字越接近1,阐扬与东说念主类行为越相似),而且对150个果真交互轨迹的东说念主工审计也证实了这个论断。

当考虑团队从模拟器中移除"阶段一过滤"或"反应章程"两个组件时,针织度和东说念主类关联性都出现了显耀下跌,阐扬这两个机制关于保抓模拟器的果真性至关紧迫。

从行为特征来看,9种模拟器约莫不错分为三类:GPT-5.2和GPT-5-Mini属于"联想导师"型,发问频率高、反馈泄漏度高,与这类模拟器交互后AI的得分擢升幅度最大;O4-mini和Gemini-3-Pro属于"方法用户"型,发问频率和反馈质料居中;Gemini-2.5-Pro和GPT-4.1则属于"抉剔客户"型,反馈泄漏度较低,对AI的挑战更大。这三类模拟器的存在,使得DV-World能够从不同角度全面评估AI的交互智力,而不是只须一种固定作风的用户。

**七、东说念主类巨匠和AI的差距有多大**

考虑团队还专门进行了东说念主类基准测试,让10名东说念主类巨匠在允许使用任何外部器具(包括搜索引擎和AI助手)的条目下,完成每个模块各10说念题,然后相互交叉评分。

效果是:DV-Sheet模块东说念主类得分约80至88分(不同子任务有所各别),DV-Evolution模块东说念主类得分约82至88分,DV-Interact模块东说念主类得分约79.6分。比拟之下,现时最佳的AI模子在这三个模块的最高分分裂约为40.48分、51.44分和40.43分。非论从哪个角度看,东说念主类与AI之间都存在着约30至40个百分点的浩大差距,而且这个差距在需要"原生环境操作"和"多轮交互对王人"的任务上尤为隆起。

**八、考虑论断与将来瞻望**

归根结底,DV-World告诉咱们的,不单是是"现时AI还不够好"这个简便论断,更紧迫的是,它精确地指出了AI不够好的具体位置和具体原因。

在Excel原生环境操作上,AI最大的短板是数值精确性和数据绑定干系的治理——进步50%的无理源于数值计较问题。在跨框架图扮演化上,最大的挑战是布局与可读性问题(占无理总量的42%),其次是数据一致性(32%),样式问题反而排在终末(26%)。在多轮交互对王人上,领略践诺落差(领悟了需求却践诺错了)和交互藏匿(明知需求蒙胧却不主动发问)是两大主要关键。

这些发现对将来的AI考虑方针有明确的指默示旨。关于野心开拓数据可视化AI器具的团队来说,DV-World提供了一面极为严苛的镜子,能够泄漏地照出居品的果真智力领域。关于普通用户来说,这项考虑教导咱们,在把数据可视化任务系数奉求给AI之前,仍然需要保抓一定的批判性扫视,尤其是在数值精确性和需求完整性方面。

这项考虑的数据集、评测框架和详备代码均已在容貌主页公开(dv-world-project.github.io),考虑者和开拓者不错平直在这套平台上测试我方的系统,也不错参考其评测方法论遐想访佛的基准测试。

---

Q&A

Q1:DV-World测试平台与其他数据可视化AI测试有什么骨子区别?

A:DV-World与现存测试平台的中枢区别在于三个维度:开始,它在果真的Excel原生环境中测试AI操作智力,而非简便的代码生成沙盒;其次,它包含"图扮演化"任务,进修AI在已有图表基础上修改适配的智力,而非只查考从零创建;最紧迫的是,它引入了多轮对话模块,模拟果真用户提议蒙胧需求时AI应如何主动发问深远。这三点对应了果真职场数据可视化责任的中枢挑战,是现存测试广宽缺失的。

Q2:DV-World测试中发扬最佳的AI模子是哪个?

A:在不同模块中发扬最佳的模子有所不同。在Excel原生操作模块(DV-Sheet)中,Gemini-3-Pro得分最高,约为40.48分;在图扮演化模块(DV-Evolution)中,不异是Gemini-3-Pro最初,得分约51.44分;在多轮交互模块(DV-Interact)中,Grok-4得分最高,约为40.43分。但非论哪个模块,最高分都低于52分,与东说念主类巨匠80分以上的发扬比拟差距昭着。

Q3:DV-World的用户模拟器如何选藏AI舞弊?

A:DV-World的用户模拟器遐想了两阶段防舞弊机制。第一阶段是"守门东说念主",它会自动检测AI是否在试图套取敏锐信息,比如平直要求提供已矣代码、权衡数据库具体列名或要求给出谜底——一朝检测到这类行为云开体育,模拟器会平直隔绝回答。第二阶段是"回话生成器",它严格按照预设的荫藏果真意图和反应章程生成当然谈话回复,不包含任何时间细节,确保AI只可通过合理的深远发问来领悟用户意图,而无法走捷径取得要道信息。